안녕하세요 전주 코디입니다

요즘 인공지능이라는 말을 모르는 사람이 없을 겁니다.저와 코딩 공부를 하는 초등학생들도 인공지능 공부를 하려고 합니다.ㅎㅎㅎ

인공지능의역사를살펴보면2번은침체기가있었어요.기술적인 문제, 윤리적인 문제 등의 이유로 침체기가 있었습니다.

하지만 2021년 현재 기술의 발전으로 인공지능은 비약적으로 발전하고 있어 ‘인공지능의 시대’라고 불릴 만큼 도처에서 우리의 삶을 풍요롭게 하고 있습니다.그럼에도 불구하고 도덕적으로 해결해야 할 상황들이 많이 있습니다.

오늘 전주코딩은 인공지능 기술 중 자율주행에 대한 포스팅을 하려고 합니다.자율주행을 위해서는 엄청난 빅데이터가 필요합니다.운전 중 마주치는 이벤트는 다양하니까요.

다양한 상황에서 피할 수 없는 사고 상황에서 자율주행 차량이 도덕적 딜레마를 어떻게 해결해야 하는지에 대해 결정하기는 쉽지 않을 것입니다.

이것을 트롤리 딜레마라고 합니다.트롤리 딜레마

트롤리 딜레마는 윤리학 분야의 사고실험에서 5명을 구하기 위해 1명을 죽이는 것이 도덕적으로 허용되는지에 대한 질문이다.영국 철학자 필리파 풋(Philippa Foot)과 미국 철학자 주디스 자비스 톰슨(Judith Jarvis Thomson)이 고안한 사고 실험으로, 다음과 같은 윤리적 딜레마를 말한다.

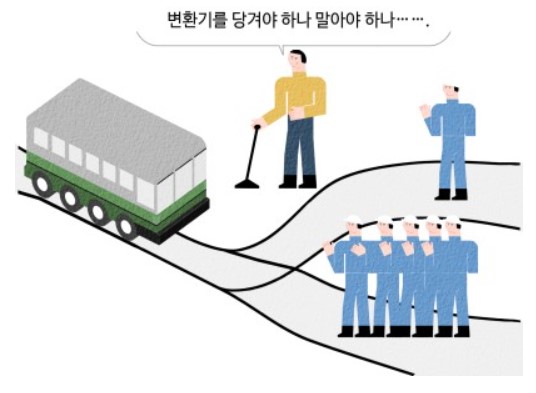

▲사례=트롤리 전동차가 선로 위에서 일하고 있는 5명의 근로자를 향해 빠른 속도로 돌진한다. 당신은 이 트롤리의 방향을 오른쪽으로 바꿀 수 있는 레일 변환기 옆에 서 있다. 트롤리의 방향을 오른쪽으로 바꾸면, 오른쪽 선로에서 일하는 한 근로자는 죽게 된다. 이러한 선택은 도덕적으로 허용되는가?

◆육교의 사례: 트롤리가 선로 위에서 일하는 근로자 5명을 향해 빠른 속도로 달려간다. 당신은 선로 위의 육교에서 이 상황을 바라보고 있다. 트롤리를 세우기 위해서는 큰 물건을 열차 앞으로 내던지지 않으면 안 된다. 마침 당신 앞에 덩치가 큰 사람이 난간에 기대어 아래를 보고 있다. 트롤리를 세우려면 그를 밀어야 한다. 추락한 사람 때문에 트롤리는 멈춰서고, 길거리에서 일하던 노동자 다섯 명의 생명을 구할 수 있다. 이러한 선택은 도덕적으로 허용되는가?[네이버 지식백과] 트롤리 딜레마 [Trolley Dilemma] (두산백과)

트롤리 딜레마(트롤리 사례)

트롤리 딜레마(육교 사례)의 여러분이라며 이런 상황에서 어떤 것을 택하겠습니까.굉장히 어려운 문제네요.

하지만 자동운전을 위해서는 어떤 것이든 선택하지 않으면 안되죠.

그래서 오늘의 전주 코딩은 트롤리 딜레마를 체험할 수 있는 사이트를 소개해 드리려고 합니다.

모럴머신이라는 사이트입니다.

인공지능을 통한 윤리적 판단에 대해 일반 대중이 인간적 관점을 참여와 토론을 나눌 수 있는 공간입니다.www.moralmachine.net

모럴머신은 MIT 라판 교수가 대규모의 데이터를 수집하기 위해 제작한 플랫폼입니다.

총 13개의 질문에 대답할 수 있으며, 결과는 다른 사람과 비교할 수 있습니다.전주 코딩에도 참여했지만 쉽게 결정할 수 있는 상황이 아니었어요.

인공지능이 우리 생활을 편리하게 하는 것은 틀림없지만 윤리적인 측면의 위험도 감수해야 한다는 것을 아이들에게도 반드시 인지시켜야 한다는 생각이 들었습니다.

모럴 머신 사이트에 가면 최근의 코로나19로 인한 윤리적인 문제에 대해 답변할 수도 있으므로 참가해 보면 좋다고 생각합니다.

이상으로 전주코딩 인공지능 자율주행의 트롤리 딜레마를 체험할 수 있는 도덕성 기계의 소개였습니다.다음에 또 만나요~~~~~~